Appleは2022年5月17日(米国時間)、ライブキャプションやドア検出機能といった新たなアクセシビリティ機能を発表しました。今回発表された新機能は、今年後半のソフトウェアアップデートで提供される予定です。

音声をリアルタイムでテキスト化する「ライブキャプション」

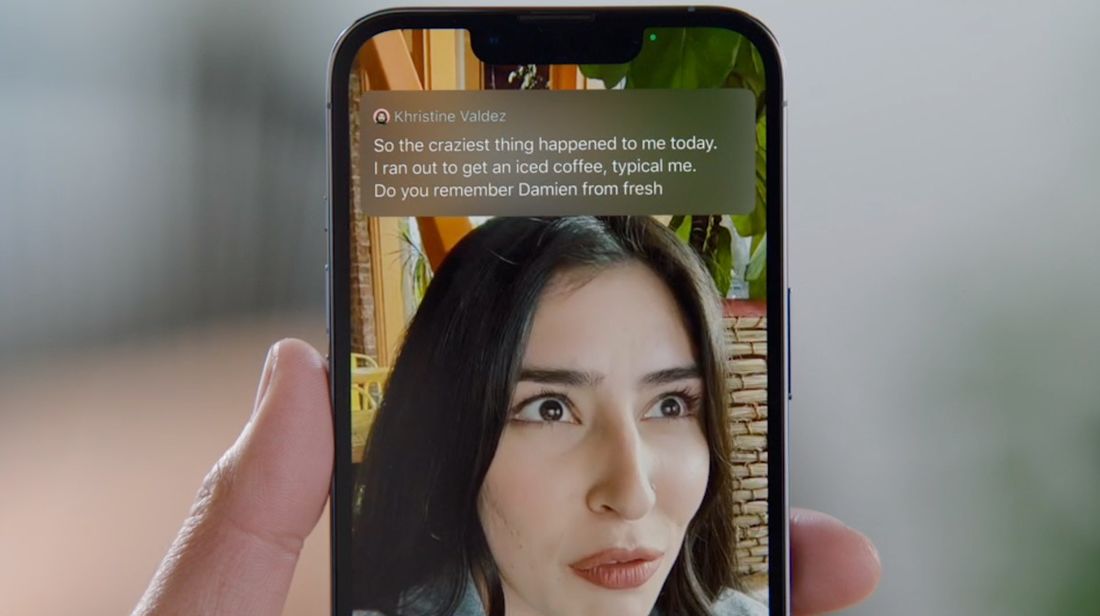

ライブキャプションは、電話やビデオ会議、映像コンテンツ、隣の人との会話といったあらゆる音声情報を、リアルタイムでテキスト化してくれる機能。耳の不自由な人でも音声情報を認識しやすくなります。

ライブキャプションで生成されたテキストは、通知バナーのように画面上部に表示されます。テキストはフォントサイズの調整にも対応します。またMacでの通話時、会話への応答をテキストで入力すると、会話に参加しているメンバーにその応答を音声で伝えられる仕組みも提供されます。

対応する端末はiPhone 11以降と、A12 Bionic以降を搭載したiPad、Appleシリコンを搭載したMac。2022年後半に米国とカナダで英語対応のベータ版としてリリースされる予定です。

ドアの位置や状態を検知する「ドア検出機能」

ドアまでの距離や周辺に記載された情報を読み上げてくれる

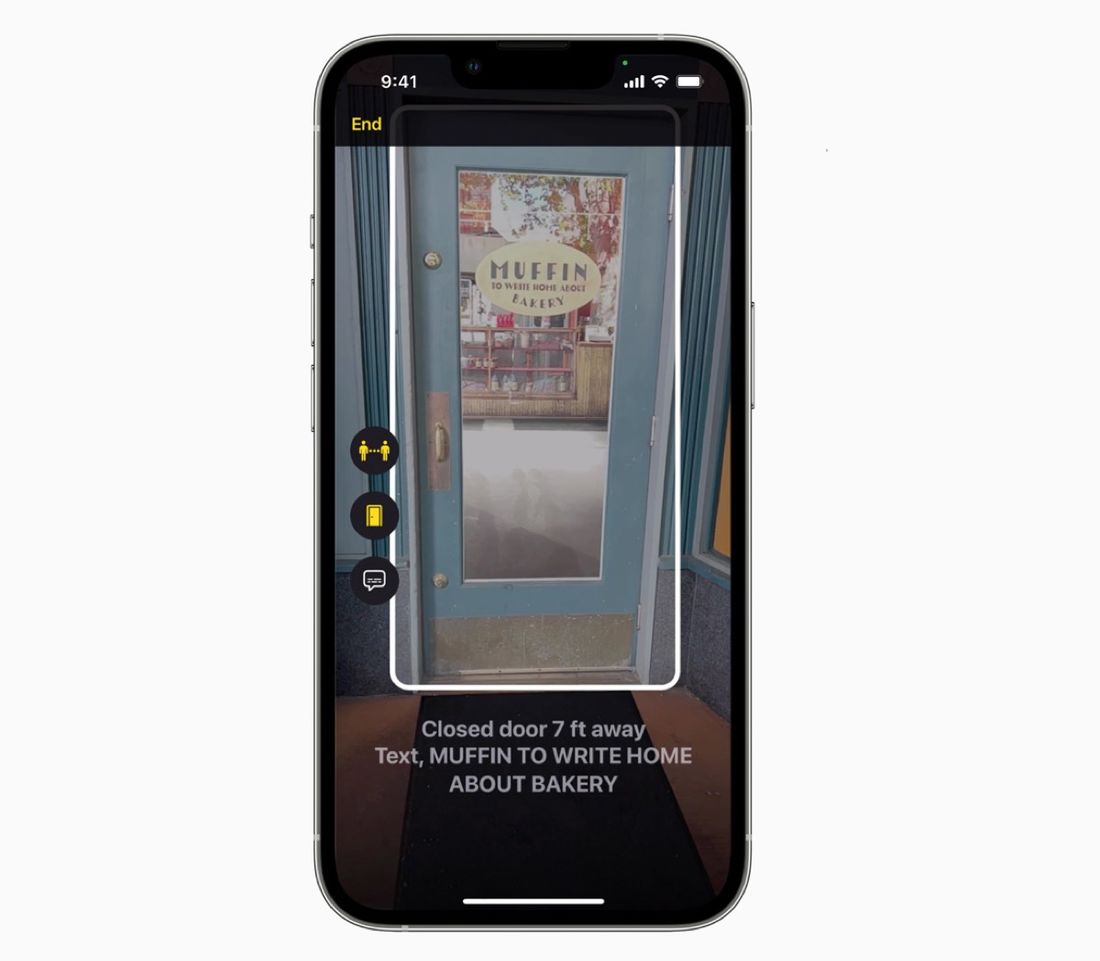

ドア検出機能は、iPhoneやiPadに搭載されたセンサー「LiDAR Scanner」を利用してドアの位置や距離、ドアの状態などを検知して情報を読み上げます。ドアの状態検知ではドアの開閉状況だけでなく、ノブを回すのかハンドルを引くのかといったドアの開け方も把握できます。

ドアについている部屋番号などのサインやシンボルも読み取ることができるため、ただドアがあるという事実だけでなく、何のドアなのかという情報まで把握可能。ドア検出機能は、iPhoneやiPadにインストールされているアクセシビリティ機能「拡大鏡」のモードの一つとして利用できるようになります。

ドア検出機能は、LiDAR Scannerを搭載したiPhone 12 Pro/Pro MaxとiPhone 13 Pro/Pro Max、11インチiPad Pro(第2・3世代)、12.9インチiPad Pro(第4・5世代)に対応します。

音声や簡単なジェスチャーでApple Watchの遠隔操作が可能に

ペアリングされたiPhoneからApple Watchの遠隔操作ができる

ペアリングされたiPhoneからの遠隔操作機能や、より多くの動作をハンドジェスチャーで操作できる機能がApple Watchに搭載されます。身体や運動に障害のある人がApple Watchを利用しやすくなります。

Apple Watchの遠隔操作「Apple Watch Mirroring」では、Apple Watchのディスプレイをタップする代わりに、音声コントロールやスイッチコントロール、ヘッドトラッキング、外付けの「Made for iPhone」スイッチなどを使用してApple Watchの操作ができます。Apple Watchの遠隔操作は、Apple Watch Series 6以降に対応します。

Apple WatchのAssistiveTouchで導入されているハンドジェスチャー機能の利用可能範囲も拡大されます。新しいハンドジェスチャー機能では、ダブルピンチ(人差指と親指を2回タップする)動作で電話の応答・終了や、通知の解除、写真の撮影、再生中のメディアの操作といった多彩なアクションを実行できるようになります。