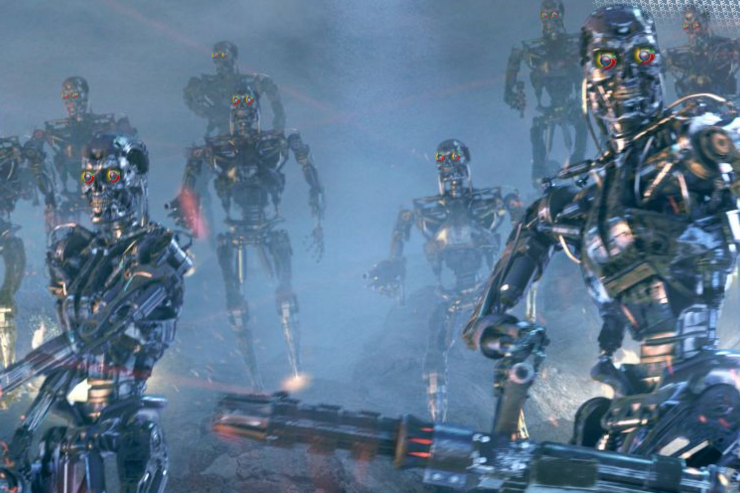

映画『ターミネーター2』では、未来の救世主ジョン・コナーを守るために、未来のジョン・コナー自身がターミネーター(T-800)を過去に送り込んだ。

Googleは、同じことを「robots.txt」を用いて実現する。robots.textとは、ウェブサイトの所有者が、検索エンジンなどのクローラー(ボット)を制御するためにサーバー上に設置するテキストファイルのこと。例えば、特定のウェブページなどへのGoogleからのアクセスを拒否したい場合、「Disallow: /****」のように指示する。

Googleがいつの間にか設置していたrobots.txt「killer-robots.txt」は、次のように指示している。

ターミネーターのT-1000とT-800に対して、Google創業者であるラリー・ペイジとセルゲイ・ブリンの殺害を拒否していることが分かる。逆に言えば、それ以外の人類の殺害を拒否していないということだ。

もちろん、これはGoogleのイースターエッグ。robots.txtの登場が1994年6月のことなので、20周年を記念したジョークなのだろう。ただ、ジョークなら「Disallow: /」「Allow:/+LarryPage」「Allow:/+SrgeyBrin」にしても良かったのではないかと思ってしまうが(2名以外の人類を殺害できなくなる)。

とは言うものの、ターミネーターの種類はT-800とT-1000だけではないことが明らかになっているので、このkiller-robots.txtはそれほど効果的なスカイネット対抗策ではないかもしれない。

SOURCE